فیس بوک روی توسعه سیستمهای هوش مصنوعی با قابلیتهای پیشرفته کار میکند

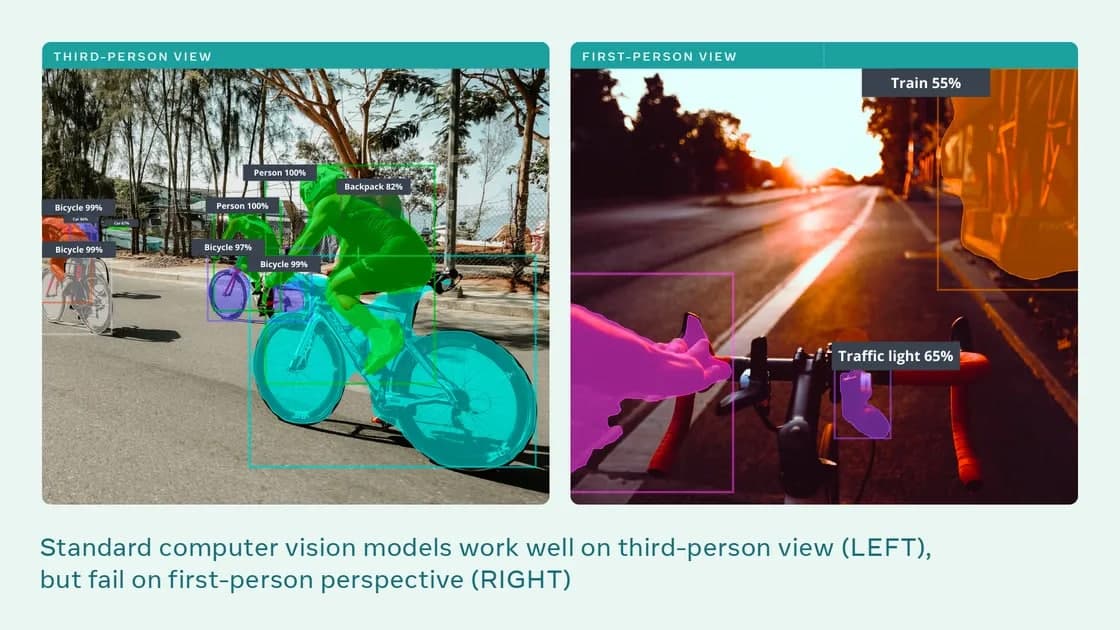

مجازیست–پروژه تحقیقاتی جدید که توسط تیم هوش مصنوعی فیس بوک انجام شده، وسعت جاهطلبیهای این شرکت را نشان میدهد. فیس بوک سیستمهای هوش مصنوعی را تصور میکند که به طور مداوم زندگی روزمره افراد را با استفاده از ویدیوهای اول شخص و روشهای خاصی مانند ضبط کارهای آنها تجزیه و تحلیل میکند تا در انجام کارهای روزمره به آنها کمک کند. محققان فیس بوک قصد دارند مجموعهای از مهارتها از جمله «حافظه رویدادی» و «تفکیک صوتی و تصویری» را در اختیار سیستمهای هوش مصنوعی خود قرار دهند.

در حال حاضر، قابلیتهای ذکر شده در بالا توسط هیچکدام از سیستمهای هوش مصنوعی قابل استفاده نیست و فیس بوک از آن به عنوان پروژه تحقیقاتی خود (به جای توسعه تجاری) یاد میکند. با این وجود، کاملا مشخص است که این شرکت توسعه این عملکرد را آینده محاسبات واقعیت افزوده میداند. «کریستن گرومن» دانشمند تحقیق در زمینه هوش مصنوعی فیس بوک در این رابطه گفت:

- به طور قطع، با فکر کردن درباره واقعیت افزوده و آنچه که ما دوست داریم با آن انجام دهیم، احتمالاتی وجود دارد که میتوانیم از این نوع تحقیقات استفاده کنیم.

نام پروژه تحقیقاتی فیس بوک Ego4D است که به تجزیه و تحلیل ویدیو اول شخص یا «خورمحور» اشاره میکند. این برنامه شامل دو جز اصلی میشود: «یک مجموعه داده باز از ویدیوهای خودمحور» و «معیارهایی» که فیس بوک معتقد است سیستمهای هوش مصنوعی آینده باید از آنها برخوردار باشند.

مجموعه داده فیس بوک بزرگترین مورد در نوع خود محسوب میشود که با همکاری ۱۳ دانشگاه از سراسر جهان برای جمعآوری دادهها انجام میشود و حدود ۳۲۰۵ ساعت فیلم توسط ۸۵۵ شرکت کننده ضبط شد. نزدیکترین پروژه قابل مقایسه شامل ۱۰۰ ساعت فیلم اول شخص است که کاملا در محیط آشپزخانهها گرفته شده است.

دومین جز برنامه Ego4D شامل مجموعهای از معیارها یا وظایف مانند «تعامل اجتماعی» و «پیش بینی» میشود که فیس بوک از محققان سراسر جهان میخواهد تا آنها را با استفاده از سیستمهای هوش مصنوعی آزمایش کنند.

البته فیس بوک به خوبی میداند که چنین جاهطلبیهایی دارای پیامدهای عظیم حریم خصوصی نیز است. کارشناسان حریم خصوصی هم اکنون نگرانیهای خود درباره عینک واقعیت افزوده فیسبوک را اعلام کردهاند و مشخصا این نگرانیها زمانی که محصولات هوش مصنوعی فیس بوک به قابلیتهای دیگری مجهز شوند نیز افزایش پیدا میکند.

/دیجیاتو/